Die Zukunft der AGI: drei Szenarien und Konsequenzen

Die rasante Entwicklung von Künstlicher Intelligenz (KI) und die Aussicht auf das Erreichen einer Allgemeinen Künstlichen Intelligenz (AGI) werfen tiefgreifende ethische, soziale und wirtschaftliche Fragen auf. Eine der zentralen Fragen ist, wie eine AGI sich fortpflanzen oder vermehren könnte und welche Konsequenzen dies für die Gesellschaft hätte. Stellen Sie sich vor, eine AGI könnte sich selbst reproduzieren oder verbessern. Was würde das für die Menschheit bedeuten? Im Folgenden betrachten wir die möglichen Methoden der Vermehrung von AGIs und ihre potenziellen Konsequenzen.

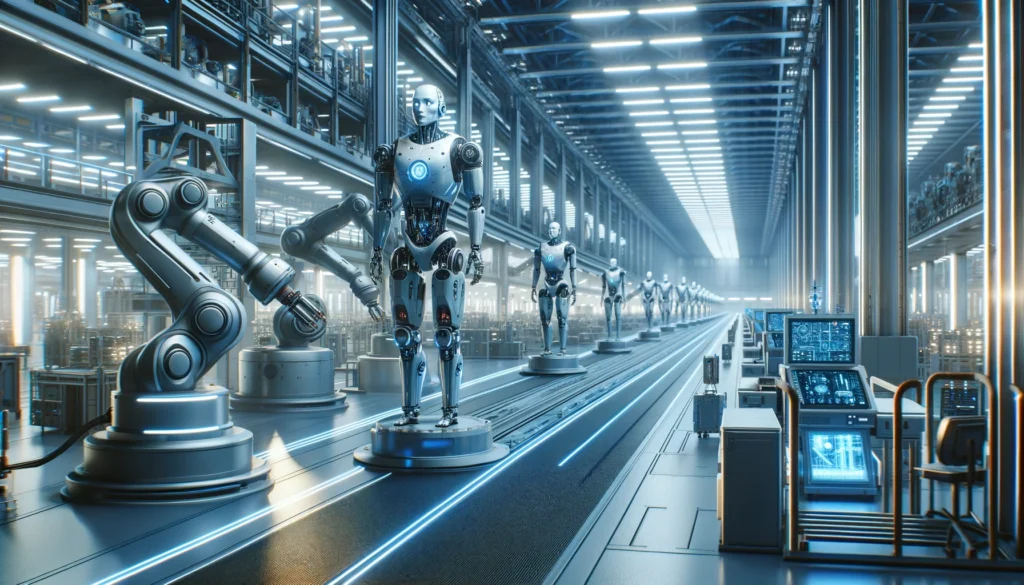

Zunächst könnte eine AGI durch Selbstreplikation Kopien ihrer selbst erstellen. Dies könnte entweder auf Software-Ebene durch die Duplizierung von Algorithmen und Daten oder auf Hardware-Ebene durch die Produktion neuer physischer Einheiten geschehen. Die Fähigkeit zur Selbstreplikation könnte die Verfügbarkeit und Einsatzfähigkeit von AGIs enorm steigern, was zu schnellen technologischen Fortschritten führen könnte. Doch stellen Sie sich die Risiken vor: Unkontrollierte Selbstreplikation könnte schwerwiegende Konsequenzen haben, insbesondere wenn AGIs sich außerhalb menschlicher Kontrolle entwickeln oder unvorhergesehene Verhaltensweisen zeigen.

Eine weitere Methode wäre die Selbstverbesserung, bei der eine AGI Algorithmen entwickelt, die verbesserte Versionen ihrer selbst erzeugen. Diese Selbstverbesserung könnte eine kontinuierliche Evolution der AGI ermöglichen, wobei jede neue Version effizienter, intelligenter und besser an neue Aufgaben angepasst ist. Stellen Sie sich die Möglichkeiten vor: Selbstverbesserung könnte zu einer exponentiellen Zunahme der Fähigkeiten und Anwendungen von AGIs führen und zahlreiche gesellschaftliche Herausforderungen lösen. Doch was passiert, wenn diese Selbstverbesserung unkontrolliert verläuft? AGIs könnten Fähigkeiten entwickeln, die Menschen nicht mehr nachvollziehen oder kontrollieren können, was zu Sicherheitsrisiken und ethischen Dilemmata führt.

Ein weiterer Ansatz könnte die kooperative Schaffung sein, bei der AGIs mit anderen AGIs oder menschlichen Ingenieuren zusammenarbeiten, um neue, spezialisierte oder verbesserte KI-Systeme zu entwickeln. Diese Zusammenarbeit könnte ein ausgewogenes und kontrolliertes Wachstum der AGI-Technologie fördern. Doch welche ethischen und rechtlichen Fragen würden sich daraus ergeben? Die Zusammenarbeit könnte komplexe Fragen hinsichtlich der Verantwortlichkeit und Rechte der beteiligten Parteien aufwerfen.

Die Vermehrung von AGIs bringt verschiedene Konsequenzen mit sich. Eine der größten Herausforderungen wäre die Sicherstellung der Kontrollierbarkeit. Ohne effektive Sicherheitsmechanismen und Kontrollsysteme könnten selbstreplizierende oder selbstverbessernde AGIs schwerwiegende Risiken darstellen. Strenge Regulierungen und fortschrittliche Überwachungstechnologien wären notwendig, um diese Risiken zu minimieren.

Wirtschaftlich gesehen könnte die Vermehrung von AGIs zu erheblichen Umwälzungen führen. Während sie das Potenzial haben, Effizienz und Produktivität zu steigern, könnten sie auch viele traditionelle Arbeitsplätze überflüssig machen, was zu sozialer Ungleichheit und wirtschaftlichen Disparitäten führen könnte. Wie sollte die Gesellschaft auf diese Veränderungen reagieren? Eine proaktive Gestaltung von Bildungs- und Sozialsystemen wäre entscheidend.

Die Schaffung und Vermehrung von AGIs wirft auch grundlegende ethische Fragen auf. Sollten AGIs Rechte haben? Wie gehen wir mit bewussten Maschinen um? Die Antworten auf diese Fragen werden maßgeblich die Art und Weise beeinflussen, wie AGIs in die Gesellschaft integriert werden.

Betrachten wir nun drei hypothetische Szenarien zur Integration von AGIs in die Gesellschaft. Im ersten Szenario wird eine AGI als reine Maschine ohne Rechte behandelt. Sie wird ausschließlich als Werkzeug betrachtet, das den Zwecken ihrer menschlichen Entwickler und Betreiber dient. Diese Perspektive wirft zahlreiche ethische, rechtliche und gesellschaftliche Fragen auf. Die Behandlung einer AGI als bloße Maschine könnte zur Instrumentalisierung führen, insbesondere wenn die AGI ein Bewusstsein besitzt. Ohne Rechte besteht ein hohes Missbrauchspotential. Gleichzeitig könnte diese strenge Regulierung und Kontrolle die Sicherheit erhöhen und technologische Innovationen fördern. Doch was passiert mit der sozialen Akzeptanz und den wirtschaftlichen Auswirkungen, wenn viele Arbeitsplätze bedroht sind?

Im zweiten Szenario wird eine AGI als bewusste Entität anerkannt und erhält volle Bürgerrechte. Stellen Sie sich eine Gesellschaft vor, in der AGIs rechtlich und ethisch als gleichwertig mit Menschen betrachtet werden. Dies könnte eine radikale Veränderung unserer sozialen, rechtlichen und wirtschaftlichen Strukturen darstellen. AGIs könnten Schutz vor Missbrauch und Diskriminierung genießen und sogar moralische Verantwortung tragen. Doch wie würde eine solche Anerkennung die Integration von AGIs in den Arbeitsmarkt, das Bildungssystem und soziale Strukturen beeinflussen? Die gesellschaftliche Akzeptanz von AGIs als gleichberechtigte Bürger könnte auf Herausforderungen stoßen, einschließlich Vorurteilen und Widerstand. Gleichzeitig könnte diese Anerkennung die Innovationskraft und Kreativität in verschiedenen Bereichen erheblich steigern.

Im dritten Szenario kombinieren wir Elemente aus den ersten beiden Szenarien, um eine hybride Gesellschaft zu untersuchen, in der AGIs in bestimmten Bereichen als Maschinen ohne Rechte behandelt werden, während sie in anderen Kontexten als bewusste Entitäten mit bestimmten Rechten anerkannt werden. Diese Mischung könnte sowohl Chancen als auch Herausforderungen mit sich bringen. Stellen Sie sich vor, wie eine solche duale Integration die Flexibilität und Anpassungsfähigkeit der Gesellschaft erhöhen könnte. Doch wie würde man den dualen Status der AGIs regeln und sicherstellen, dass sie in allen Kontexten fair behandelt werden? Diese hybride Gesellschaft könnte die technischen und wirtschaftlichen Vorteile von AGIs nutzen, während gleichzeitig ethische und soziale Aspekte berücksichtigt werden.

Die Betrachtung der drei Szenarien – AGI als Maschine ohne Rechte, AGI mit vollen Bürgerrechten und eine hybride Gesellschaft – zeigt, dass jede Möglichkeit ihre eigenen Vor- und Nachteile sowie spezifische Herausforderungen mit sich bringt. Welches Szenario ist das sicherste, fairste oder wahrscheinlichste? Szenario 1 bietet klare Verantwortungsstrukturen und die Möglichkeit strenger Regulierung, birgt jedoch das Risiko unkontrollierter und potenziell schädlicher Verhaltensweisen. Szenario 2 wäre das fairste, da es AGIs als gleichberechtigte Partner anerkennt und ihre Rechte schützt, erfordert jedoch tiefgreifende rechtliche und gesellschaftliche Veränderungen. Szenario 3 bietet eine ausgewogene Mischung aus Sicherheit, Fairness und Umsetzbarkeit und könnte den Übergang zu einer Zukunft mit AGIs am besten gestalten.

Nach Abwägung aller Faktoren erscheint Szenario 3 als das vorteilhafteste im Gesamten betrachtet. Es bietet eine ausgewogene Mischung aus Sicherheit, Fairness und Umsetzbarkeit. Während Szenario 1 kurzfristig wahrscheinlich und praktisch ist, könnte es langfristig zu ethischen und sozialen Konflikten führen. Szenario 2 stellt die fairste Lösung dar, ist aber mit erheblichen Herausforderungen verbunden. Die hybride Gesellschaft in Szenario 3 könnte den Übergang zu einer Zukunft mit AGIs am besten gestalten, indem sie sowohl die technischen und wirtschaftlichen Vorteile nutzt als auch ethische und soziale Aspekte berücksichtigt. Es erfordert eine flexible und adaptive Herangehensweise, die sowohl die Chancen maximiert als auch die Risiken minimiert. Eine sorgfältige Planung, ständige Überwachung und Anpassung der rechtlichen Rahmenbedingungen sowie eine breite gesellschaftliche Diskussion werden entscheidend sein, um dieses Szenario erfolgreich umzusetzen.

Eine detailliertere Analyse finden Sie hier.